![An der Schnittstelle von Controlling und Management: Shareholder Value Maximierung durch kombinatorische Optimierung und Hybrid-KI]()

Die

Maximierung des Shareholder Value gilt als eines der zentralen Leitziele moderner Unternehmensführung. In der Unternehmenspraxis wird dabei häufig unterstellt, dass rationale, datenbasierte und methodisch saubere Investitionsentscheidungen automatisch zu einer wertmaximierenden Kapitalallokation führen. Genau diese Annahme ist jedoch nur eingeschränkt tragfähig. Denn zwischen der rationalen Bewertung einzelner Investitionen und der tatsächlich optimalen Allokation von Kapital besteht ein struktureller Unterschied.

Unternehmen verfügen heute über leistungsfähige ERP-Systeme, ausgereifte Controlling-Prozesse, umfangreiche Forecasts und etablierte Instrumente wie

Kapitalwertmethode, IRR-Berechnung,

Szenarioanalyse oder Projektportfolio-Management. Dennoch bleibt der tatsächlich realisierte Shareholder Value in vielen Fällen hinter dem theoretisch möglichen zurück. Der Grund liegt nicht primär in mangelhafter Datenverfügbarkeit oder fehlender fachlicher Kompetenz, sondern in einer grundsätzlichen

Begrenzung der Entscheidungslogik: Meist wird nicht der vollständige Entscheidungsraum betrachtet, sondern nur ein vorab reduzierter Ausschnitt.

Mit wachsender Anzahl von Investitionsprojekten, Restriktionen und Zielkonflikten steigt die Komplexität nicht linear, sondern exponentiell. Ein Portfolio mit mehreren Investitionsoptionen erzeugt einen

kombinatorischen Entscheidungsraum, der sich mit klassischen Mitteln nur noch eingeschränkt beherrschen lässt. Wo klassische Verfahren Komplexität reduzieren müssen, eröffnet die Verbindung aus kombinatorischer Optimierung, Hybrid-KI und präzisem Parallel Computing die Möglichkeit, große Teile dieses Raumes systematisch zu berechnen.

Der vorliegende Beitrag entwickelt vier zentrale Erkenntnisse. Erstens liegt der größte Werthebel nicht im Einzelprojekt, sondern im Portfolio. Zweitens darf

Komplexität nicht lediglich reduziert, sondern muss rechnerisch adressiert werden. Drittens sind

Opportunitätskosten der bislang am stärksten unterschätzte Verlusttreiber in der Kapitalallokation. Viertens ist der strukturelle Renditeverlust vieler Unternehmen nicht zufällig, sondern Ausdruck eines Zusammenspiels aus Modell-, Organisations- und Realitätsgrenzen.

1. Einleitung: Die Illusion rationaler Kapitalallokation

Die Maximierung des Shareholder Value erscheint auf den ersten Blick als

klassisches Rationalitätsproblem. Unternehmen identifizieren Investitionsmöglichkeiten, bewerten deren Risiken und Renditen, priorisieren nach wirtschaftlichen Kennzahlen und allokieren Kapital dorthin, wo der größte Wertbeitrag vermutet wird. Diese Logik ist tief in den Denkstrukturen des Controllings verankert und bildet bis heute das Rückgrat vieler Investitionsentscheidungen.

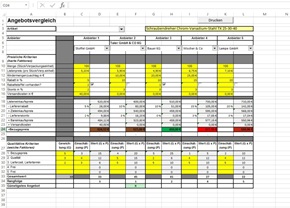

Anzeige

RS Controlling-System:

RS Controlling-System: Das RS- Controlling-System bietet

Planung, Ist- Auswertung und Forecasting in einem Excel-System. Monatliche und mehrjährige Planung. Ganz einfach Ist- Zahlen mit Hilfe von Plan/Ist-Vergleichen, Kennzahlen und Kapitalflussrechnung analysieren.

Alle Funktionen im Überblick >>.

Insbesondere das Controlling hat die Aufgabe, Transparenz zu schaffen, Investitionen vergleichbar zu machen und wirtschaftlich fundierte Entscheidungsgrundlagen bereitzustellen. Instrumente wie die

Kapitalwertmethode, der

interne Zinsfuß,

Sensitivitätsanalysen,

Szenariotechniken oder projektbezogene Business Cases sind dafür unverzichtbar. Auch

Projektportfolio-Management hat sich als wichtiges Steuerungsinstrument etabliert, um Projekte zu strukturieren, zu priorisieren und mit Budgets sowie strategischen Zielen in Einklang zu bringen.

Dennoch zeigt die Unternehmenspraxis ein paradoxes Bild. Trotz steigender Datenverfügbarkeit, immer besserer Softwarelandschaften und professioneller Finanzsteuerung bleibt die

tatsächliche Qualität der Kapitalallokation häufig hinter ihrem Potenzial zurück. Unternehmen treffen gute und plausible Entscheidungen, ohne zwingend die wirtschaftlich beste Entscheidung zu treffen. Genau an dieser Stelle beginnt die eigentliche Problematik.

Die zentrale These dieses Beitrags lautet daher: Das Hauptproblem liegt nicht in der Bewertung einzelner Projekte, sondern in der

unzureichenden Betrachtung des gesamten Entscheidungsraums. Mit jeder zusätzlichen Investitionsoption wächst die Anzahl möglicher Kombinationen exponentiell. Klassische Verfahren stoßen an diesem Punkt nicht an operative, sondern an strukturelle Grenzen. Die Folge ist nicht zwingend eine falsche Entscheidung, wohl aber häufig eine suboptimale. Und genau diese Differenz ist für den Shareholder Value entscheidend.

2. Das strukturelle Problem: Exponentielle Entscheidungsräume

2.1 Kombinatorische Explosion

Sobald mehrere Investitionsprojekte gleichzeitig zur Auswahl stehen, ist die eigentliche Managementfrage nicht mehr, ob ein einzelnes Projekt wirtschaftlich sinnvoll ist, sondern welche

Kombination von Projekten unter gegebenen Restriktionen den höchsten Wertbeitrag erzeugt.

Mathematisch führt dies zu einem kombinatorischen Problem: Bei

N N potenziellen Projekten existieren 2^

N mögliche Portfoliokombinationen.

Die

Größenordnung dieses Problems wird oft unterschätzt. Bei 10 Projekten ergeben sich 1.024 mögliche Kombinationen, bei 20 Projekten bereits 1.048.576. Bei 30 Projekten liegt der Raum bei über einer Milliarde Möglichkeiten, bei 50 Projekten im Bereich von über einer Billiarde. Schon bei moderaten Projektzahlen wird damit offensichtlich, dass eine vollständige Bewertung mit klassischen Methoden praktisch nicht mehr möglich ist.

Die Relevanz dieser exponentiellen Skalierung ist enorm. Denn sie bedeutet, dass jede zusätzliche Investitionsoption nicht nur eine weitere Entscheidung erzeugt, sondern den gesamten Lösungsraum verdoppelt. Komplexität wächst damit nicht additiv, sondern sprunghaft. Aus Sicht des Controllings entsteht ein

strukturelles Problem: Je größer das Portfolio, desto stärker sinkt die Wahrscheinlichkeit, dass die tatsächlich beste Kombination ohne spezifische Optimierungslogik erkannt wird.

2.2 Konsequenzen für das Controlling

In der Praxis reagiert das Controlling auf diese Komplexität mit

Verfahren der Reduktion. Es werden Projekte vorab selektiert, in Prioritäten überführt, entlang von Scoring-Modellen gewichtet oder durch harte Budgetgrenzen gefiltert. Oft entscheiden zusätzlich Gremien, Bereichslogiken oder strategische Leitplanken darüber, welche Optionen überhaupt noch im engeren Auswahlraum verbleiben. Szenarioanalysen ergänzen diese Logik, bleiben jedoch typischerweise auf wenige Varianten beschränkt.

Diese Verfahren sind nachvollziehbar und in vielen Fällen sogar notwendig. Sie schaffen Orientierung, senken Komplexität und erhöhen die Handhabbarkeit von Entscheidungen. Gleichzeitig erzeugen sie jedoch eine grundlegende Verzerrung: Es wird nicht die beste Lösung im gesamten Entscheidungsraum identifiziert, sondern die beste Lösung in einem

vorab eingeschränkten Teilraum. Das Management entscheidet damit rational, aber eben nur innerhalb eines künstlich verkleinerten Feldes von Möglichkeiten.

Genau hierin liegt der strukturelle Verlustmechanismus. Denn mit jeder Vorselektion steigt die Wahrscheinlichkeit, dass Kombinationen ausgeschlossen werden, die in Summe wirtschaftlich überlegen gewesen wären. Das Controlling verliert damit nicht nur Alternativen aus dem Blick, sondern auch den Zugang zu den

Opportunitätskosten der gewählten Lösung.

3. Klassische Controlling-Instrumente im Kontext komplexer Entscheidungsräume

3.1 Stärken etablierter Methoden

Es wäre falsch, aus dieser Problemdiagnose eine generelle Kritik an klassischen Controlling-Instrumenten abzuleiten. Im Gegenteil: Kapitalwertmethode, IRR, Szenarioanalysen, Budgetierungsverfahren und Projektportfolio-Management bleiben essenzielle Bestandteile rationaler Unternehmenssteuerung. Sie schaffen Vergleichbarkeit, erzeugen Transparenz auf Projektebene, strukturieren Entscheidungsprozesse und integrieren finanzielle Zielgrößen in die operative und strategische Steuerung.

Gerade in der

Einzelprojektbewertung sind diese Verfahren hoch wirksam. Sie zwingen Organisationen dazu, Investitionen systematisch zu durchdenken, finanzielle Effekte zu quantifizieren und Risiken explizit zu machen. Ohne diese Instrumente wäre jede weitergehende Optimierung inhaltlich leer, weil sie keinen belastbaren Input hätte.

3.2 Systemische Grenzen

Die Grenzen dieser Instrumente liegen daher nicht in ihrer fachlichen Qualität, sondern in ihrer Anwendung auf

hochkomplexe Portfoliosysteme. Erstens erfolgt die Bewertung meist isoliert auf Ebene des Einzelprojekts, obwohl reale Interdependenzen bestehen. Projekte konkurrieren um Kapital, binden dieselben Ressourcen, beeinflussen zeitliche Umsetzungsfenster oder verstärken sich gegenseitig. Zweitens arbeiten viele Verfahren implizit mit linearen Denkmodellen, obwohl die wirtschaftlichen Effekte im Portfolio häufig nicht linear sind. Drittens fehlt in vielen Organisationen die mathematische Gesamtoptimierung des Portfolios als eigenständige Entscheidungsebene. Viertens bleiben Opportunitätskosten in der Regel implizit, weil alternative Kombinationen nicht systematisch durchgerechnet werden.

Das Ergebnis ist eine Form rationaler

Teiloptimierung. Einzelne Investitionen werden sauber bewertet, doch die übergeordnete Logik des Portfolios bleibt nur teilweise sichtbar. Genau deshalb sind klassische Methoden unverzichtbar, aber nicht ausreichend.

4. Der Paradigmenwechsel: Von Priorisierung zu Optimierung

4.1 Priorisierung als Heuristik

Priorisierung ist in der Managementpraxis eines der wichtigsten Instrumente zur Komplexitätsbeherrschung. Projekte werden nach Dringlichkeit, Wirtschaftlichkeit, strategischer Bedeutung oder Risiko gereiht. Rankings, Scoring-Modelle und subjektive Gewichtungen sind weit verbreitet und in vielen Organisationen tief verankert. Solche Verfahren sind sinnvoll, solange sie als Heuristik verstanden werden: als

Näherungslösung unter begrenzten Ressourcen.

Problematisch wird Priorisierung dann, wenn sie implizit mit Optimierung verwechselt wird. Denn eine priorisierte Liste ist noch kein Beweis dafür, dass die daraus abgeleitete Projektkombination wirtschaftlich optimal ist. Priorisierung reduziert Komplexität, aber sie berechnet nicht das globale Optimum.

4.2 Optimierung als mathematischer Ansatz

Optimierung setzt auf einer anderen Ebene an. Sie fragt nicht, welches Projekt isoliert betrachtet am attraktivsten ist, sondern welche Kombination von Projekten unter gegebenen Restriktionen den höchsten Gesamtwert erzeugt. Dazu wird das

Entscheidungsproblem formal beschrieben: über Zielfunktionen, Restriktionen und Entscheidungsvariablen.

Die Zielfunktion kann etwa auf Maximierung des Kapitalwerts, der Rendite, des EBIT-Beitrags oder einer Multi-Kriterien-Logik beruhen. Restriktionen umfassen typischerweise Budgetgrenzen, Kapazitätsverfügbarkeit, Risikoobergrenzen, regulatorische Anforderungen oder strategische Nebenbedingungen. Entscheidungsvariablen definieren, ob ein Projekt realisiert, verschoben, skaliert oder verworfen wird.

Der entscheidende Unterschied liegt darin, dass Optimierung nicht auf eine plausibel wirkende Reihenfolge zielt, sondern auf die Berechnung der

wirtschaftlich besten Gesamtentscheidung. Aus Sicht des Controllings markiert dies einen tiefgreifenden Wandel: weg von heuristischer Auswahl, hin zu modellbasierter Wertmaximierung.

5. Kombinatorische Optimierung als theoretische Grundlage

5.1 Einordnung in die Operations-Research-Theorie

Das hier beschriebene Problem ist theoretisch keineswegs neu. Es ist im Operations Research seit langem bekannt und gehört zur Klasse

kombinatorischer Optimierungsprobleme. Dazu zählen insbesondere Knapsack-Varianten, Portfolio Selection Problems, Scheduling-Probleme und andere NP-schwere Problemklassen. Diese Probleme sind mathematisch präzise formulierbar, aber mit klassischen Verfahren oft nicht effizient vollständig lösbar.

Die theoretische Bedeutung ist erheblich: Die optimale Kapitalallokation ist nicht bloß eine betriebswirtschaftliche Wunschvorstellung, sondern ein formal definierbares Optimierungsproblem. Dass dieses Problem in der Vergangenheit nur eingeschränkt praktisch handhabbar war, lag nicht an mangelnder theoretischer Fundierung, sondern an der begrenzten Rechen- und Modellierungsfähigkeit in realen Unternehmenskontexten.

5.2 Bedeutung für das Controlling

Für das Controlling folgt daraus eine wichtige Einsicht. Wenn Kapitalallokation ein kombinatorisches Optimierungsproblem ist, dann reichen klassische Bewertungslogiken auf Projektebene strukturell nicht aus, um das wertmaximierende Portfolio zu identifizieren. Das bedeutet nicht, dass traditionelle Methoden obsolet werden. Es bedeutet aber, dass sie in komplexen Systemen durch eine zusätzliche rechnerische Ebene ergänzt werden müssen.

Die Konsequenz ist fundamental: Die

optimale Kapitalallokation war theoretisch schon lange denkbar, praktisch jedoch oft nicht vollständig berechenbar. Erst moderne Optimierungsverfahren verschieben diese Grenze.

6. Hybrid-KI und Parallel Computing als Lösungsansatz

6.1 Begriffliche Einordnung

Hybrid-KI bezeichnet in diesem Kontext die Verbindung mehrerer rechnerischer Ansätze. Dazu gehören mathematische Optimierung, algorithmische Heuristiken und gegebenenfalls datengetriebene Modelle. Im Unterschied zu rein generativen oder rein prognostischen KI-Systemen steht hier nicht die Mustererkennung, sondern die Entscheidungsermittlung im Vordergrund.

Parallel Computing ergänzt diese Logik, indem viele Berechnungsschritte gleichzeitig ausgeführt werden können. Gerade in großen kombinatorischen Räumen ist dies entscheidend, weil sich die Rechenzeit drastisch reduzieren lässt und damit Such- und Optimierungsräume bearbeitbar werden, die mit linearen Verfahren praktisch unzugänglich wären.

6.2 Wirkmechanismus

Durch die Verbindung aus kombinatorischer Optimierung, Hybrid-KI und präzisem Parallel Computing können große Teile des Entscheidungsraums systematisch analysiert werden. Relevante Kombinationen werden effizient identifiziert, Restriktionen gleichzeitig berücksichtigt und Zielgrößen integriert bewertet. Damit verschiebt sich die Qualität der Entscheidungsbasis grundlegend.

Im Kern wird eine neue Entscheidungsebene geschaffen. Nicht mehr nur Einzelprojekte werden bewertet, sondern der gesamte Portfolioraum wird auf wirtschaftliche Überlegenheit hin untersucht. Das Management erhält damit keine bloße Prioritätenliste, sondern eine rechnerisch belastbare Portfoliologik.

6.3 Genauigkeit und praktische Relevanz

In realen Anwendungen können solche Systeme eine sehr hohe Präzision erreichen. Entscheidungsräume werden nicht nur oberflächlich durchsucht, sondern in einer Tiefe analysiert, die für klassische Managementinstrumente praktisch unerreichbar ist. Für das Controlling bedeutet dies eine qualitative Veränderung: Entscheidungen sind nicht mehr lediglich plausibel und argumentativ konsistent, sondern quantitativ deutlich belastbarer.

Wichtig ist dabei: Hohe rechnerische Genauigkeit bedeutet nicht deterministische Sicherheit. Wohl aber erhöht sie die Wahrscheinlichkeit, dass das Management den wirtschaftlich überlegenen Lösungsraum tatsächlich erkennt.

7. Wirkung auf den Shareholder Value

7.1 Der größte Hebel liegt im Portfolio, nicht im Einzelprojekt

Die erste zentrale Erkenntnis lautet: Der größte Werthebel liegt nicht im Einzelprojekt, sondern im Portfolio. Viele Unternehmen fokussieren sich darauf, einzelne Investitionen möglichst sauber zu bewerten. Diese Logik greift zu kurz. Denn Shareholder Value entsteht nicht dadurch, dass viele gute Projekte genehmigt werden, sondern dadurch, dass Kapital in jene Kombination allokiert wird, die unter realen Bedingungen den höchsten Gesamtwertbeitrag erzeugt.

Ein Projekt kann isoliert betrachtet attraktiv sein und gleichzeitig in einer bestimmten Portfoliokonstellation Wert vernichten. Umgekehrt kann ein Projekt mit mittlerem Einzelrating

im Zusammenspiel mit anderen Maßnahmen erhebliche zusätzliche Wirkung entfalten. Entscheidend ist daher nicht nur die Güte einzelner Projekte, sondern ihre Interaktion im Portfolio.

7.2 Kombinationseffekte, Sequenzierungseffekte und Restriktionsnutzung

Die zweite operative Einsicht betrifft die Hebel der Wertsteigerung. Erstens entstehen

Kombinationseffekte: Der Wert eines Portfolios ist nicht einfach die Summe seiner Einzelteile. Zweitens spielen Sequenzierungseffekte eine zentrale Rolle. Nicht nur welche Projekte realisiert werden, sondern auch in welcher zeitlichen Reihenfolge, beeinflusst Liquidität, Reinvestitionsfähigkeit und Gesamtrendite. Drittens führt die optimale Nutzung begrenzter Ressourcen zu Effizienzgewinnen, die in klassischen Priorisierungslogiken oft verborgen bleiben.

Gerade die

Zeitdimension wird in vielen Unternehmen unterschätzt. Eine zeitlich kluge Umsetzung kann Mittel früher freisetzen und damit Folgeinvestitionen ermöglichen, die sonst nicht realisierbar wären. Der Shareholder Value ist daher nicht nur eine Frage der Auswahl, sondern auch der Reihenfolge.

7.3 Opportunitätskosten als zentrale Größe

Die dritte zentrale Erkenntnis lautet: Opportunitätskosten sind der bislang am stärksten unterschätzte Verlusttreiber in der Kapitalallokation. Unternehmen messen Kosten, Budgets, Cashflows und Renditen. Was sie in der Regel nicht messen, ist der Wert der nicht gewählten Alternativen.

Genau hier setzt Optimierung an. Durch den systematischen Vergleich verschiedener Portfoliokombinationen werden

Opportunitätskosten erstmals explizit sichtbar. Das Controlling kann damit nicht nur bewerten, ob ein gewähltes Portfolio wirtschaftlich sinnvoll ist, sondern auch quantifizieren, wie groß die Differenz zum besseren oder besten Portfolio ausfällt. Erst dadurch wird der eigentliche Shareholder-Value-Verlust transparent.

8. Wissenschaftliche Einordnung

8.1 Anschlussfähigkeit an bestehende Theorien

Der beschriebene Ansatz ist wissenschaftlich anschlussfähig an mehrere etablierte Theoriegebiete. Dazu gehören die moderne Portfoliotheorie, das Operations Research, die normative Entscheidungstheorie sowie Teile der

Behavioral Economics. Besonders relevant ist die Verbindung von finanzwirtschaftlicher Bewertung mit formaler Optimierungslogik.

Während die moderne Portfoliotheorie vor allem

Risiko-Rendite-Zusammenhänge einzelner Assets oder Assetklassen analysiert, erweitert der hier behandelte Ansatz diese Perspektive auf komplexe, restriktionsbehaftete Investitions- und Projektportfolios.

Operations Research liefert die methodische Grundlage zur Beschreibung und Lösung der zugrundeliegenden Optimierungsprobleme. Die normative Entscheidungstheorie ordnet den Ansatz als Versuch ein, unter gegebenen Präferenzen und Restriktionen die beste Entscheidung zu bestimmen.

8.2 Erweiterung klassischer Modelle

Klassische Investitionsrechnungen fokussieren häufig auf Einzelobjekte. Der hier beschriebene Ansatz erweitert diese Logik um Interdependenzen, Restriktionen und zeitliche Dimensionen. Er verlagert den Fokus von der isolierten Vorteilhaftigkeit einzelner Investitionen hin zur globalen Vorteilhaftigkeit einer Gesamtstruktur.

8.3 Abgrenzung zu Machine Learning

Wichtig ist zudem die Abgrenzung zu klassischem

Machine Learning. Machine Learning erkennt Muster, schätzt Wahrscheinlichkeiten oder erzeugt Prognosen. Optimierung dagegen berechnet Entscheidungen. Machine Learning ist primär datengetrieben und prognostisch, Optimierung primär modellgetrieben und normativ. Im Unternehmenskontext werden beide Ansätze oft vermischt, obwohl sie unterschiedliche Funktionen erfüllen. Für die Maximierung des Shareholder Value ist diese Unterscheidung zentral.

9. Implikationen für das Controlling

9.1 Vom Reporting zur Entscheidungsarchitektur

Aus den bisherigen Überlegungen ergibt sich eine tiefgreifende Veränderung der Rolle des Controllings. Es entwickelt sich von einer primär berichts- und bewertungsorientierten Funktion hin zu einer aktiven Entscheidungsarchitektur. Das Controlling liefert nicht mehr nur Informationen über bereits entwickelte Optionen, sondern gestaltet die rechnerische Struktur, in der optimale Entscheidungen erst sichtbar werden.

9.2 Erweiterte Aufgaben

Daraus folgen neue Aufgabenprofile. Dazu gehören die Modellierung von Entscheidungsräumen, die Definition und Validierung von Restriktionen, die Interpretation von Optimierungsergebnissen und die Kommunikation von Opportunitätskosten. Hinzu kommt die Aufgabe, Zielsysteme so zu operationalisieren, dass sie rechnerisch verarbeitbar und gleichzeitig strategisch sinnvoll bleiben.

9.3 Governance und Nachvollziehbarkeit

Auch Governance-seitig ergeben sich neue Chancen. Optimierungsbasierte Verfahren können die Transparenz erhöhen, Entscheidungsalternativen nachvollziehbarer machen und die Fundierung von Investitionsentscheidungen verbessern. Das ist nicht nur aus Effizienzsicht relevant, sondern auch für Aufsichtsgremien, Investoren und

interne Governance-Strukturen.

10. Grenzen und kritische Betrachtung – vertiefte Analyse

Die dargestellten Potenziale kombinatorischer Optimierung und Hybrid-KI in der Kapitalallokation sind erheblich. Für eine

fundierte Einordnung im Controlling-Kontext ist jedoch eine differenzierte Betrachtung der Grenzen zwingend erforderlich. Diese liegen weniger in der mathematischen Theorie als vielmehr in der praktischen Anwendung, der Modellierung und der organisatorischen Einbettung. Gerade weil Optimierungssysteme eine neue Qualität rechnerischer Fundierung ermöglichen, ist es umso wichtiger, ihre Grenzen klar zu benennen.

10.1 Modellabhängigkeit – „Garbage in, optimum out“

Der erste kritische Punkt ist die

Modellabhängigkeit. Optimierungsmodelle sind deterministisch im Sinne ihrer Struktur, aber vollständig abhängig von den eingespeisten Daten. Dazu zählen Investitionsvolumina, erwartete Cashflows, Zeitprofile, Risikoannahmen und Abhängigkeiten zwischen Projekten. Ein mathematisch korrekt berechnetes Optimum ist deshalb nur so valide wie die zugrunde liegenden Annahmen.

Fehlerhafte, verzerrte oder unvollständige Eingabedaten führen nicht zu zufälligen Abweichungen, sondern zu systematisch falschen Ergebnissen – häufig mit hoher scheinbarer Präzision. Gerade diese Kombination aus mathematischer Strenge und potenziell fehlerhaftem Input ist riskant, weil sie zu einem trügerischen Sicherheitsgefühl führen kann.

Hinzu kommt die

Subjektivität in der Modellierung. Auch wenn die Berechnung objektiv erfolgt, bleibt die Entscheidung, welche Restriktionen berücksichtigt werden, wie Risiken parametrisiert werden oder welche Zielgrößen Priorität erhalten, eine genuin menschliche. Ob ein Modell primär auf ROI, Liquidität, Risiko, EBIT oder ESG-Wirkung optimiert, verändert den Lösungsraum fundamental. Die Objektivität der Berechnung ersetzt deshalb nicht die Subjektivität der Modellentscheidung, sondern verlagert sie.

Ein weiterer Aspekt ist die

Sensitivität von Optimierungsergebnissen. Kleine Änderungen in Annahmen können insbesondere bei eng geschnittenen Portfolios zu veränderten optimalen Kombinationen führen. Sensitivitätsanalysen, Szenariobetrachtungen und robuste Optimierungsansätze sind daher keine optionalen Ergänzungen, sondern integrale Bestandteile einer professionellen Anwendung.

Schließlich besteht auch im Optimierungskontext eine Art

Overfitting-Risiko. Modelle können so stark auf bestimmte Annahmen, Restriktionen oder Zielsysteme zugeschnitten sein, dass ihre Generalisierbarkeit sinkt. Dies betrifft besonders stark parametrisierte Zielsysteme und komplexe Restriktionsarchitekturen.

10.2 Komplexität der Implementierung – organisatorische Realität

Die zweite Grenze liegt in der

Implementierung. Technisch sind viele Optimierungslösungen heute beherrschbar. Die eigentliche Schwierigkeit liegt meist weniger in der Systemintegration als in der Entscheidungsintegration. Es stellt sich nicht nur die Frage, ob Ergebnisse berechnet werden können, sondern wer sie nutzt, wie sie interpretiert werden und wie sie in bestehende Entscheidungsroutinen eingebettet werden.

Ein häufig zu beobachtendes Muster ist, dass neue Technologie verfügbar ist, während die eigentlichen Entscheidungsprozesse unverändert bleiben. Optimierung erzeugt dann zwar neue Informationen, verändert aber die Logik der tatsächlichen Entscheidungsfindung nicht. Damit würde das Potenzial der Technologie nur teilweise ausgeschöpft.

Hinzu kommen

Akzeptanzprobleme im Management. Optimierungssysteme verschieben die Entscheidungslogik weg von Intuition, Erfahrungsdominanz und politischer Verhandlung hin zu modellbasierter Fundierung. Dies kann als Machtverschiebung erlebt werden. Skepsis gegenüber „berechneten“ Lösungen, wahrgenommener Kontrollverlust oder die Infragestellung etablierter Entscheidungsstrukturen sind daher keine Randthemen, sondern typische Implementierungsbarrieren.

Darüber hinaus sind Unternehmen keine rein rationalen Systeme. Bereichsinteressen, historische Allokationen, Budgetverhandlungen und informelle Machtstrukturen beeinflussen Investitionsentscheidungen erheblich. Ein mathematisch optimales Portfolio ist deshalb nicht automatisch politisch durchsetzbar. Genau hierin liegt eine zentrale Organisationsgrenze.

Auch das Controlling selbst ist von diesem Wandel betroffen. Die Nutzung von Optimierungssystemen erfordert neue Kompetenzen: Verständnis von Optimierungslogik, Fähigkeit zur Interpretation von Ergebnissen und reflektierter Umgang mit Unsicherheit und Modellgrenzen. Das Controlling entwickelt sich dadurch von einer berichtsorientierten zu einer modell- und entscheidungssteuernden Funktion.

Schließlich bestehen

Herausforderungen in Datenstruktur und Skalierung. Zwar ist nicht zwingend eine vollständige ERP-Integration erforderlich, dennoch müssen Daten konsistent, Projekte vergleichbar und Bewertungslogiken harmonisiert sein. Gerade in großen Organisationen gilt häufig: Daten sind vorhanden, aber nicht in einer entscheidungsfähigen Form strukturiert.

10.3 Keine vollständige Deterministik – Grenzen der Berechenbarkeit

Die dritte Grenze betrifft die Realität selbst. Optimierungsmodelle arbeiten mit erwarteten Cashflows, prognostizierten Kosten und geschätzten Risiken. Diese Größen sind per Definition unsicher. Das bedeutet: Das berechnete Optimum ist immer ein Optimum unter Annahmen, nicht unter der tatsächlichen Zukunft.

Hinzu kommen

dynamische Umweltbedingungen. Märkte verändern sich, regulatorische Rahmen verschieben sich, Technologien entwickeln sich weiter, geopolitische Risiken treten plötzlich auf. Ein heute optimales Portfolio kann morgen suboptimal sein. Daraus folgt, dass Optimierung nicht als einmalige Berechnung verstanden werden darf, sondern als kontinuierlicher Prozess der Re-Optimierung.

Zudem gibt es nicht modellierbare oder nur

schwer quantifizierbare Faktoren. Dazu zählen kulturelle Aspekte, strategische Intuition, langfristige Visionen oder qualitative Marktchancen. Nicht alles, was unternehmerisch relevant ist, lässt sich in ein mathematisches Modell überführen. Optimierung kann diese Faktoren teilweise approximieren, aber nicht vollständig ersetzen.

Ein besonderer Fall sind

Black-Swan-Risiken, also Extremereignisse wie Finanzkrisen, Pandemien oder disruptive Technologiesprünge. Solche Ereignisse sind definitionsgemäß kaum prognostizierbar. Optimierungsmodelle können sie nicht antizipieren, sondern bestenfalls die Robustheit gegen Unsicherheit erhöhen.

Schließlich ist zwischen rechnerischer Präzision und realer Sicherheit zu unterscheiden. Eine hohe mathematische Genauigkeit darf nicht mit Zukunftssicherheit verwechselt werden. Die Präzision der Berechnung ist nicht gleichbedeutend mit der Sicherheit der Realität.

10.4 Erweiterte kritische Perspektive: Systemische Implikationen

Aus den genannten Grenzen folgt eine wichtige systemische Konsequenz: Optimierungssysteme liefern Entscheidungsgrundlagen, aber sie treffen nicht die Entscheidung im rechtlichen oder strategischen Sinne. Die Verantwortung bleibt beim Management. Modelle unterstützen, ersetzen aber nicht die Führungsverantwortung.

Daraus ergibt sich auch das

Risiko der Überautomatisierung. Ein blindes Folgen von Modellvorschlägen kann zu Fehlentscheidungen führen, wenn Annahmen falsch gesetzt oder Kontextfaktoren nicht ausreichend berücksichtigt wurden. Die produktivste Form der Nutzung liegt deshalb nicht in der Substitution menschlicher Entscheidung, sondern in der Verbindung von mathematischer Optimierung und strategischer Bewertung.

10.5 Zusammenfassung der kritischen Punkte

Die Grenzen lassen sich in drei Kernbereiche zusammenfassen:

Modellgrenzen, Organisationsgrenzen und Realitätsgrenzen. Modellgrenzen betreffen die Abhängigkeit von Daten, Annahmen und Zielsystemen. Organisationsgrenzen betreffen Integration, Akzeptanz und Governance. Realitätsgrenzen betreffen Unsicherheit, Dynamik und Nicht-Modellierbarkeit.

Die Kernaussage dieser kritischen Einordnung lautet daher: Optimierungssysteme ermöglichen eine fundamental bessere Entscheidungsbasis, aber keine perfekte Entscheidung. Ihr Fortschritt liegt darin, Entscheidungsräume wesentlich vollständiger zu analysieren, Opportunitätskosten sichtbar zu machen und Kapitalallokation strukturell zu verbessern. Unsicherheit bleibt bestehen, Modellierung bleibt entscheidend und menschliche Verantwortung bleibt unverzichtbar.

11. Warum 95 % aller Unternehmen trotz guter Controller systematisch Rendite verlieren

Diese These wirkt bewusst zugespitzt, ist jedoch strukturell begründbar. Die meisten Unternehmen verfügen über qualifizierte Controller, etablierte Planungsprozesse, fundierte Bewertungsmethoden und umfangreiche Daten. Und dennoch bleibt ein erheblicher Teil des möglichen Shareholder Value ungenutzt.

Der Grund liegt nicht in individueller Fehlleistung, sondern in einem

systemischen Problem der Entscheidungsarchitektur. Gute Controller bewerten Projekte häufig sauber. Kapitalwerte werden berechnet, Risiken eingeschätzt, Szenarien analysiert. Das Problem entsteht an anderer Stelle: Diese Bewertungen erfolgen isoliert und nicht im Kontext aller möglichen Kombinationen. Gute Einzelentscheidungen führen deshalb nicht automatisch zum optimalen Gesamtergebnis.

Hinzu kommen

unsichtbare Opportunitätskosten. In klassischen Prozessen wird das gewählte Portfolio bewertet, nicht jedoch das bestmögliche Portfolio. Der Unterschied zwischen „gewählt“ und „optimal“ bleibt damit unsichtbar, obwohl genau dieser Unterschied den eigentlichen Shareholder-Value-Verlust ausmacht.

Außerdem wird

Komplexität traditionell reduziert statt berechnet. Priorisierung, Budgetgrenzen, Vorauswahl und Gremienentscheidungen sind notwendige Instrumente, führen aber dazu, dass der Entscheidungsraum vor der eigentlichen Entscheidung künstlich verkleinert wird. Das Optimum wird damit systematisch ausgeschlossen, bevor es überhaupt betrachtet werden kann.

Dazu kommt die

Unterschätzung der zeitlichen Sequenzierung. Viele Unternehmen konzentrieren sich auf die Frage, welche Projekte umgesetzt werden sollen, und zu wenig darauf, wann welche Projekte umgesetzt werden sollten. Gerade die Reihenfolge hat jedoch massiven Einfluss auf Liquidität, Reinvestitionsfähigkeit und Gesamtrendite.

Schließlich gilt: Daten sind vorhanden, werden aber häufig nicht entscheidungsfähig genutzt. Mehr Daten führen nicht automatisch zu besseren Entscheidungen. Erst die Fähigkeit zur ganzheitlichen Berechnung macht aus Daten eine wertmaximierende Entscheidungsbasis.

Die eigentliche Ursache lässt sich daher präzise formulieren: Unternehmen verlieren Rendite nicht, weil sie grundsätzlich falsch entscheiden, sondern weil sie nicht vollständig entscheiden können.

12. Das Zusammenspiel der drei Grenzen als Gesamtbild

Die zuvor beschriebenen Einzelprobleme lassen sich auf drei fundamentale Ebenen zurückführen:

Modellgrenzen, Organisationsgrenzen und Realitätsgrenzen. Erst durch ihr Zusammenspiel wird das volle Ausmaß des Effekts sichtbar.

Unvollständige Modelle liefern ein eingeschränktes Bild der Realität. Organisationale Einschränkungen verhindern die optimale Nutzung vorhandener Erkenntnisse. Externe Unsicherheit begrenzt die Vorhersagbarkeit zusätzlich. Diese Ebenen wirken nicht isoliert, sondern verstärken sich gegenseitig. Modellunsicherheit wird durch organisatorische Verzerrung verschärft. Organisationale Hemmnisse behindern Modellverbesserung. Unsicherheit wird mangels Berechenbarkeit häufig durch Heuristik überkompensiert.

Gerade deshalb bleibt Optimierung trotz aller Grenzen ein struktureller Fortschritt. Der entscheidende Unterschied zwischen klassischem Ansatz und Optimierung liegt darin, dass nicht mehr nur ein Teilraum heuristisch bearbeitet, sondern ein wesentlich größerer Raum rechnerisch durchdrungen wird. Implizite Kosten werden explizit, Priorisierung wird durch Optimierung ergänzt und die Gesamtlogik des Portfolios wird überhaupt erst sichtbar.

Fazit: Ein struktureller Wandel der Entscheidungslogik

Die Maximierung des Shareholder Value ist weniger ein Problem der Informationsverfügbarkeit als ein

Problem der Entscheidungslogik. Klassische Controlling-Instrumente bleiben essenziell, reichen jedoch nicht aus, um exponentielle Entscheidungsräume vollständig zu adressieren. Wo Komplexität mit klassischen Mitteln reduziert werden muss, eröffnet die Integration von kombinatorischer Optimierung, Hybrid-KI und präzisem Parallel Computing eine neue Qualität der Unternehmenssteuerung.

Die vier zentralen Erkenntnisse dieses Beitrags lassen sich zusammenfassen: Erstens liegt der größte

Werthebel im Portfolio und nicht im Einzelprojekt. Zweitens darf Komplexität nicht lediglich vereinfacht, sondern muss berechnet werden. Drittens sind Opportunitätskosten der unsichtbare Kern wirtschaftlicher Fehlallokation. Viertens entsteht struktureller Renditeverlust aus einem Zusammenspiel von Modell-, Organisations- und Realitätsgrenzen.

Die finale Kernaussage lautet daher: Unternehmen treffen heute überwiegend rationale Entscheidungen – jedoch innerhalb eines

unvollständig betrachteten Entscheidungsraums. Perfekte Entscheidungen sind nicht möglich, aber strukturell bessere Entscheidungen sind berechenbar. Und genau darin liegt der zukünftige Wettbewerbsvorteil: nicht in mehr Daten, nicht in mehr Erfahrung, sondern in der Fähigkeit, den Entscheidungsraum vollständiger zu verstehen, systematisch zu berechnen und daraus eine wirtschaftlich überlegene Portfoliologik abzuleiten.

letzte Änderung S.R.

am 27.04.2026

Autor:

Sascha Rissel

|

Autor:in

|

Herr Sascha Rissel

Sascha Rissel ist Unternehmer, Strategieberater und CEO der mAInthink GmbH. Er verfügt über mehr als 20 Jahre Erfahrung in der Entwicklung, Skalierung und Optimierung komplexer Geschäftsmodelle sowie in der Steuerung strategischer Investitions- und Projektportfolios. Sein Schwerpunkt liegt auf der Analyse und Verbesserung von Entscheidungsprozessen in Organisationen.

|

|

Homepage |

weitere Fachbeiträge des Autors

| Forenbeiträge

|

Über 200 Kennzahlen aus Finanzen, Personal, Logistik, Produktion, Einkauf, Vertrieb, eCommerce und IT.

Über 200 Kennzahlen aus Finanzen, Personal, Logistik, Produktion, Einkauf, Vertrieb, eCommerce und IT. Wie erstelle ich ein Tacho- oder Ampel-Diagramm? Wie kann ich Abweichungen in Tabellen ansprechend visualisieren? Das wird Ihnen hier anschaulich erklärt.

Wie erstelle ich ein Tacho- oder Ampel-Diagramm? Wie kann ich Abweichungen in Tabellen ansprechend visualisieren? Das wird Ihnen hier anschaulich erklärt.  Viel ist zum Berichtswesen oder Reporting schon geschrieben worden. Dennoch zeigen Umfragen, dass rund 50 Prozent der Empfänger von Berichten mit dem Reporting nicht zufrieden sind. Jörgen Erichsen erklärt in diesem Buch die Bedeutung und die Handhabung des Berichtswesens speziell für kleinere Betriebe. Mit zahlreichen Beschreibungen, Beispielen und Checklisten.

Viel ist zum Berichtswesen oder Reporting schon geschrieben worden. Dennoch zeigen Umfragen, dass rund 50 Prozent der Empfänger von Berichten mit dem Reporting nicht zufrieden sind. Jörgen Erichsen erklärt in diesem Buch die Bedeutung und die Handhabung des Berichtswesens speziell für kleinere Betriebe. Mit zahlreichen Beschreibungen, Beispielen und Checklisten.

Essendi steht für mehr als den reinen Hotelbetrieb – wir schaffen die Dynamik, die Hotels erfolgreich macht. Als europäischer Marktführer im Economy- und Midscale-Segment investieren und agieren wir mit einem klaren Ziel: jede unserer Immobilien in einen nachhaltigen, lebendigen und bedeutungsvol... Mehr Infos >>

Essendi steht für mehr als den reinen Hotelbetrieb – wir schaffen die Dynamik, die Hotels erfolgreich macht. Als europäischer Marktführer im Economy- und Midscale-Segment investieren und agieren wir mit einem klaren Ziel: jede unserer Immobilien in einen nachhaltigen, lebendigen und bedeutungsvol... Mehr Infos >>

Die Handwerkskammer Wiesbaden hat mehr als 27.000 Mitgliedsbetriebe. Sie sorgt für eine gemeinsame und solidarische Vertretung der Anliegen aller Handwerkerinnen und Handwerker in Politik und Öffentlichkeit. Unter dem Motto „praxisnah und fachkundig“ bietet die Handwerkskammer maßgeschneiderte Be... Mehr Infos >>

Die Handwerkskammer Wiesbaden hat mehr als 27.000 Mitgliedsbetriebe. Sie sorgt für eine gemeinsame und solidarische Vertretung der Anliegen aller Handwerkerinnen und Handwerker in Politik und Öffentlichkeit. Unter dem Motto „praxisnah und fachkundig“ bietet die Handwerkskammer maßgeschneiderte Be... Mehr Infos >>

Menschen machen den Unterschied. Seit der Gründung im Jahr 1919 hat sich unser Familienunternehmen zu einem führenden Anbieter in den Bereichen Feuerverzinkung, Beschichtung, Rietbergbehälter und Gitterroste entwickelt. Heute arbeiten mehr als 1.750 Mitarbeitende an 20 Standorten in Deutschland, ... Mehr Infos >>

Menschen machen den Unterschied. Seit der Gründung im Jahr 1919 hat sich unser Familienunternehmen zu einem führenden Anbieter in den Bereichen Feuerverzinkung, Beschichtung, Rietbergbehälter und Gitterroste entwickelt. Heute arbeiten mehr als 1.750 Mitarbeitende an 20 Standorten in Deutschland, ... Mehr Infos >>

Wir sind der erste Ansprechpartner für die Marken Volvo, Peugeot und Ford im Raum Aschaffenburg. Freuen Sie sich auf ein modernes, innovatives Autohaus und wachsen Sie mit uns! Wir bieten Ihnen: Flexible Arbeitszeiten, Ab dem ersten Tag einen unbefristeten Arbeitsvertrag, 30 Tage Urlaub, Verkürzt... Mehr Infos >>

Wir sind der erste Ansprechpartner für die Marken Volvo, Peugeot und Ford im Raum Aschaffenburg. Freuen Sie sich auf ein modernes, innovatives Autohaus und wachsen Sie mit uns! Wir bieten Ihnen: Flexible Arbeitszeiten, Ab dem ersten Tag einen unbefristeten Arbeitsvertrag, 30 Tage Urlaub, Verkürzt... Mehr Infos >>

Die Max-Planck-Gesellschaft zur Förderung der Wissenschaften e. V. (MPG) ist eine von Bund und Ländern finanzierte Selbstverwaltungsorganisation der Wissenschaft. Sie betreibt in gegenwärtig 85 Instituten und Forschungsstellen im In- und Ausland Grundlagenforschung auf natur- und geistesw... Mehr Infos >>

Die Max-Planck-Gesellschaft zur Förderung der Wissenschaften e. V. (MPG) ist eine von Bund und Ländern finanzierte Selbstverwaltungsorganisation der Wissenschaft. Sie betreibt in gegenwärtig 85 Instituten und Forschungsstellen im In- und Ausland Grundlagenforschung auf natur- und geistesw... Mehr Infos >>

Zur Unterstützung der drei kirchlichen Grundaufträge in der Erzdiözese München und Freising besteht jeweils eine eigenständige vermögensverwaltende Stiftung: Die Bischof-Arbeo-Stiftung (Ziel: Förderung von Bildung), die St. Antonius-Stiftung (Ziel: Förderung des Dienstes am Nächsten, ... Mehr Infos >>

Zur Unterstützung der drei kirchlichen Grundaufträge in der Erzdiözese München und Freising besteht jeweils eine eigenständige vermögensverwaltende Stiftung: Die Bischof-Arbeo-Stiftung (Ziel: Förderung von Bildung), die St. Antonius-Stiftung (Ziel: Förderung des Dienstes am Nächsten, ... Mehr Infos >>

Das Leibniz-Institut für Finanzmarktforschung SAFE – Sustainable Architecture for Finance in Europe – (www.safe-frankfurt.de) fördert Forschung und unabhängige Politikberatung zu allen Aspekten, die sich mit der Struktur und Funktionsweise des Finanzsystems befassen. Es verfolgt das Ziel,... Mehr Infos >>

Das Leibniz-Institut für Finanzmarktforschung SAFE – Sustainable Architecture for Finance in Europe – (www.safe-frankfurt.de) fördert Forschung und unabhängige Politikberatung zu allen Aspekten, die sich mit der Struktur und Funktionsweise des Finanzsystems befassen. Es verfolgt das Ziel,... Mehr Infos >>

Forschung für eine Gesellschaft im Wandel: Das ist unser Antrieb im Forschungszentrum Jülich. Als Mitglied der Helmholtz-Gemeinschaft stellen wir uns den großen gesellschaftlichen Herausforderungen unserer Zeit und erforschen interdisziplinär die digitalisierte Gesellschaft, ein klimaschonende... Mehr Infos >>

Forschung für eine Gesellschaft im Wandel: Das ist unser Antrieb im Forschungszentrum Jülich. Als Mitglied der Helmholtz-Gemeinschaft stellen wir uns den großen gesellschaftlichen Herausforderungen unserer Zeit und erforschen interdisziplinär die digitalisierte Gesellschaft, ein klimaschonende... Mehr Infos >>

Tipps, Charts und Diagramme für Ihre tägliche Arbeit mit Microsoft Excel® im Controlling. Präsentiert von Controlling-Portal.de. Sogenannte Dashboards werden heute vom Management erwartet. Möglichst auf einem Blatt sollen alle wichtigen Kennzahlen auf einem Blick erfassbar sein.

Tipps, Charts und Diagramme für Ihre tägliche Arbeit mit Microsoft Excel® im Controlling. Präsentiert von Controlling-Portal.de. Sogenannte Dashboards werden heute vom Management erwartet. Möglichst auf einem Blatt sollen alle wichtigen Kennzahlen auf einem Blick erfassbar sein.

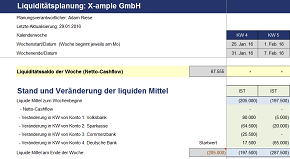

Rollierende Liquiditätsplanung auf Wochenbasis. Mit der Excel-Vorlage „Liquiditätstool“ erstellen Sie schnell und einfach ein Bild ihrer operativen Liquiditätslage für die nächsten (bis zu 52) Wochen. Mehr Infos und Download >>

Rollierende Liquiditätsplanung auf Wochenbasis. Mit der Excel-Vorlage „Liquiditätstool“ erstellen Sie schnell und einfach ein Bild ihrer operativen Liquiditätslage für die nächsten (bis zu 52) Wochen. Mehr Infos und Download >>